获取 Github commit 通知请进入关联群组

@ZGQinc_chat_room

频道主的个人主页

domain.zgqinc.gq

网页版

tg.zgqinc.gq

RSS订阅

https://tg.zgqinc.gq/rss.xml

@ZGQinc_chat_room

频道主的个人主页

domain.zgqinc.gq

网页版

tg.zgqinc.gq

RSS订阅

https://tg.zgqinc.gq/rss.xml

Skidrowreloaded和DODI Repacks打包整理了目前所有的游戏本体+Hypervisor补丁,可信渠道,搜索

hypervisor即可。有件事忘了说,事实上我想训练自己的语音助手是因为Gemini关个灯要反应10秒,本地专用模型会快很多。有些时候感觉NLP用神经网络去处理一句“关掉卧室的灯”这种简单的自然语言反而效率太低,没有傻里傻气的纯NLU高效,但是换个角度,NLP反而能理解“我要睡觉了,关灯”这种话,会关闭全屋的灯,而不像NLU会傻愣愣的问你关闭哪些区域的灯,看个人使用习惯了,这个确实不能比。

S26U的蓝牙S Pen没有回归,期望落空,防窥屏其实我不是很感兴趣。本来不太想说,但刚刚有人问我为什么S26跑分打不过国产手机,和电池容量没有长进。回答前者,我觉得你是没看过极客湾视频,三星调度虽然怂但恰恰说明没有作弊,更何况之前因为Game Optimizing Service有作弊嫌疑被Geekbench除名了S10到S22,现在更怂了;回答后者,至于电池容量一方面是联合国的锅,容量做大了很难跨国运输,已经有人解释过这种情况了,我就不赘述了,另一方面还是因为爆炸门,现在电池寿命也是全部牌子里面最高的,之前确实用过凝胶电池,但是放电效率差,后来不用了。

https://t.me/SecHorse/136946

我发现我对便携性总有一种执念,能上PD全都上,电烙铁是正点原子T90B,数控电源是菲尼瑞斯DPS-150,加热台是嘉立创65瓦PD项目,包括目前在做的秘密项目也上了PD充电。所以PD功率能供电的热风枪到底什么时候问世啊,USB-IF协会给点力啊。

我发现我对便携性总有一种执念,能上PD全都上,电烙铁是正点原子T90B,数控电源是菲尼瑞斯DPS-150,加热台是嘉立创65瓦PD项目,包括目前在做的秘密项目也上了PD充电。所以PD功率能供电的热风枪到底什么时候问世啊,USB-IF协会给点力啊。

https://dracofenrir.booth.pm/items/5740233

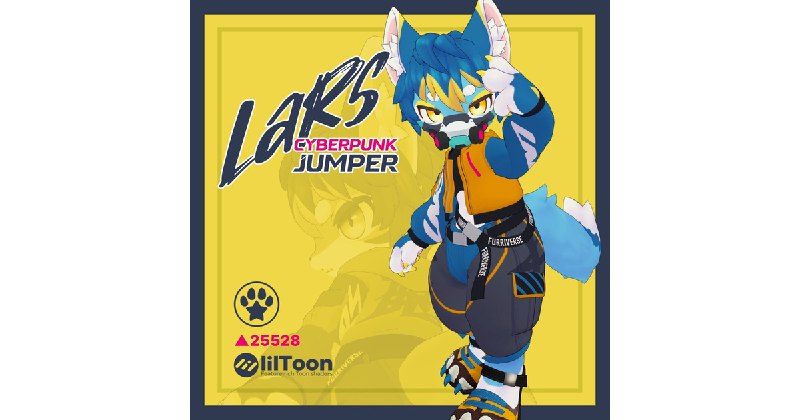

自购,给自己的VRChat模型买了套衣服。是的没错,算是预告了,底模当然是 https://dracofenrir.booth.pm/items/4698854 ,改模师在完善细节,应该快了。

衣服下载:https://t.me/ZGQinc_chat_room/59480

RipperStore帖子:https://forum.ripper.store/topic/96429/lars-%E3%83%A9%E3%83%BC%E3%82%B9-cyberpunk-jumper-by-furriverse-download

模型本体下载:https://forum.ripper.store/post/572045

自购,给自己的VRChat模型买了套衣服。是的没错,算是预告了,底模当然是 https://dracofenrir.booth.pm/items/4698854 ,改模师在完善细节,应该快了。

衣服下载:https://t.me/ZGQinc_chat_room/59480

RipperStore帖子:https://forum.ripper.store/topic/96429/lars-%E3%83%A9%E3%83%BC%E3%82%B9-cyberpunk-jumper-by-furriverse-download

模型本体下载:https://forum.ripper.store/post/572045

https://youtu.be/tKGhxMi50y8

我去,来真的。

我去,来真的。

https://github.com/ZGQ-inc/home-llm-cn

WIP。

基于Gemma3训练一个Home Assistant专用的轻量模型,示例基于 google/gemma-3-1b-it,引入HA的数据集进行微调,训练LoRA权重。

最大的难点在于Gemma3不支持Function Calling,而这是HA的语音助手必须的,网上有文章教你用歪门邪道让Gemma3知道怎么样Function Calling,包括官方:

https://ai.google.dev/gemma/docs/capabilities/function-calling?hl=zh-cn

https://www.philschmid.de/gemma-function-calling

https://www.reddit.com/r/LocalLLaMA/comments/1jauy8d/giving_native_tool_calling_to_gemma_3_or_really/

关键是Gemma3-1b实在是太蠢了,我浪费了6度电也没教会,连谷歌官方的方法也一样,甚至训练开始没多久就开始过拟合,数据污染,各种幻觉,退化重复,不知道谷歌看到自家1b模型蠢成这样会不会笑,求助过Gemini,但是每次思考到一半莫名其妙卡死了,说自己是文本模型,无法处理这种问题,猜测是模型内部出问题,Gemini是支持Function Calling的,当出现tool_call之后可能模型自己以为要Function Calling了,然后就在等待客户端汇报结果,然后就卡死了,系统故障处理自动退出,目前是完全无计可施。

WIP。

基于Gemma3训练一个Home Assistant专用的轻量模型,示例基于 google/gemma-3-1b-it,引入HA的数据集进行微调,训练LoRA权重。

最大的难点在于Gemma3不支持Function Calling,而这是HA的语音助手必须的,网上有文章教你用歪门邪道让Gemma3知道怎么样Function Calling,包括官方:

https://ai.google.dev/gemma/docs/capabilities/function-calling?hl=zh-cn

https://www.philschmid.de/gemma-function-calling

https://www.reddit.com/r/LocalLLaMA/comments/1jauy8d/giving_native_tool_calling_to_gemma_3_or_really/

关键是Gemma3-1b实在是太蠢了,我浪费了6度电也没教会,连谷歌官方的方法也一样,甚至训练开始没多久就开始过拟合,数据污染,各种幻觉,退化重复,不知道谷歌看到自家1b模型蠢成这样会不会笑,求助过Gemini,但是每次思考到一半莫名其妙卡死了,说自己是文本模型,无法处理这种问题,猜测是模型内部出问题,Gemini是支持Function Calling的,当出现tool_call之后可能模型自己以为要Function Calling了,然后就在等待客户端汇报结果,然后就卡死了,系统故障处理自动退出,目前是完全无计可施。